בשנים האחרונות נחשפים פרטים בנוגע לעולם סינון התוכן בפלטפורמות הדיגיטליות, ולהיותו ה"חצר האחורית" של הרשתות החברתיות. שאלות מהותיות עלו לדיון - מהו תוכן ראוי ומה לא, ומהו המחיר שמשלמים מסנני התכנים שצריכים לקבל את ההחלטות הללו. השבוע פורסם תחקיר נוסף של The Verge אודות מסנני תוכן בארצות הברית - עובדים שבמקרה של חברת פייסבוק מועסקים באמצעות חברות קבלן. שלושה מהמרואיינים במסגרת התחקיר, מסנני תוכן לשעבר, העידו בשמם המלא ובפנים גלויות - למרות הסכמי סודיות וחשיפתם לתביעות משפטיות.

אחד מהם תיאר את הסרטון הראשון שראה בתפקיד: שני נערים זיהו איגואנה על הרצפה, אחד הרים אותה מהזנב, והחל להטיח אותה על רצפת הרחוב. "האיגואנה צרחה ובכתה והם לא הפסיקו עד שהיא הייתה גוש מדמם". לפי העדות, למרות הזעזוע העמוק שהעובד חש עקב המראות, הסרטון לא הפר את תנאי הקהילה של פייסבוק - ולכן נשאר באוויר.

אותה שרירותיות אבסורדית שמאפיינת את מדיניות החברה ומנחה את מסנני התוכן שלה, מוצגת כיום לקהל הרחב במסגרת הצגה שעולה בתל-אביב. את ההצגה יצרו ד"ר ליאור זלמנסון, חוקר מערכות מידע ומרצה באוניברסיטת חיפה, והמייסד של פסטיבל "פרינט סקרין" לאומנות דיגיטלית, והאמנית ואשת החינוך מיה מגנט. לצורך כך הם התבססו על מצגות מודלפות מקורס מסנני תוכן שפרסם ה"גרדיאן" ב-2017, ועל תחקירים נוספים בנושא שנעשו מאז.

בפתיחת ההצגה, מגנט, שמשחקת את המדריכה בקורס, מסבירה כי משרה זו עדיין מאוישת על-ידי עובדים אנושיים - ולא מכונות - מאחר ש"אנחנו זקוקים לאינטליגנציה ולמוסר שלכם". אך מהר מאוד מתברר כי בעבודה מהסוג הזה, בני האדם דווקא נדרשים לתפקד כמכונות: כללי החברה שמוצגים מסבירים כי יש להם שניות בודדות לעבור על פוסט, מותר להם לבצע עד שלוש טעויות בחודש בלבד, ואין להם באמת מקום להפעיל את תפיסת המוסר או את האינטליגנציה שלהם, מאחר שהחלטותיהם צריכות להסתמך בצורה עיוורת על הכללים של פייסבוק - שנראים לפעמים שרירותיים להחריד.

ליאור זלמנסון/ צילום: בוריס גילטבורג

"נסיר סרטונים של הפלה רק אם הם כוללים עירום", "ילדים אינם מהווים קבוצה פגיעה, אבל נשיאים כן", ו"עירום מותר רק אם הוא מוצג באומנות אמיתית". אלה רק חלק מההנחיות למסנני התוכן שמוזכרות בהצגה, בה הקהל הוא משתתף פעיל שמתבקש ללמוד את החוקים ולתרגל את היישום שלהם על פוסטים שונים - כמו איום ברצח נגד טראמפ, תיאור של אקט מיני מפורש, תמונות של עירום בשואה, וקריאה לביצוע לינץ' בתינוקות ערבים. פעם אחר פעם מוצגים לקהל תמונות ופוסטים שדווחו על-ידי משתמשים, והוא צריך להחליט - באמצעות סימון "לייק" או "דיסלייק" - אם להשאיר את הפוסט או להסירו. פעמים רבות התרגול ואף החוקים עצמם יצרו בקרב הקהל תחושת אי נוחות ותגובות של התנגדות.

בנוסף למצגות שמבוססות על תוכן הקורס האמיתי שהודלף, ההצגה מלווה גם בטקסט דרמטי של הדמות בהצגה אשר מעורר את חוויית סינון התוכן לחיים, כשהיא חולקת כביכול מניסיונה. באחד הקטעים, היא משתפת במקרה שמזכיר את החוויה הטראומתית עליה סיפר מסנן התוכן שנחשף לסרטון האלים נגד האיגואנה, ושוב מבטא את שרירותיות החוקים: במסגרת עבודתה, היא נתקלה בסרטון של ילד שנפצע קשות, אמנם לא כתוצאה מהתעללות מכוונת, אך לא מקבל כל עזרה מהאנשים שסביבו.

מדריכה מספרת לקהל החניכים כי לא הייתה יכולה להסיר את הסרטון מהרשת החברתית - מאחר שלא עבר על שום כלל. מיד לאחר מכן, היא פוצחת בנאום על החשיבות בשמירת הכללים ובהימנעות מהכנסת תפיסות אישיות של נכון ולא נכון לעבודה - מה שרק מעורר בקהל תחושת אי נוחות רבה יותר.

בתחילת ההצגה, המשתתפים מתבקשים לחתום על טופס הסכם סודיות עם "הרשת החברתית". בהמשך, במהלך ה"קורס", מוסבר לחניכים כי מקום העבודה אוסר על שימוש בטלפונים ועל הכנסת כלי כתיבה וניירות למשרד, כולל עטיפות מסטיקים שיכולות לשמש לכתיבה, ועל הוצאת מידע מן המשרדים. "יצרנו את ההצגה כי הרגשנו שאף אחד לא יודע על זה, כאילו זה סוד. להצגה קוראים 'I Don’t Want to See This' - ואנחנו מעמתים אנשים מול זה שאנשים אחרים צריכים לראות את כל מה שהם לא רוצים לראות. הרבה אנשים יוצאים החוצה באמצע כי קשה להם", אומר זלמנסון.

על שאלות כמו מהי אומנות אמיתית או אילו קבוצות באוכלוסייה נחשבות לפגיעות, אין תשובה חד משמעית, והן עוררו את התגובות החזקות ביותר מהקהל בהצגה. מה רציתם להראות באמצעותן?

"רצינו להראות סיטואציות בהן מסנני תוכן צריכים לקבל החלטות כביכול אובייקטיביות בתחומים שברור שאין בהם שיפוט אובייקטיבי", מסביר זלמנסון. "ברגע שאנחנו מנסים להגדיר עולמות מופשטים - כמו אומנות - אנחנו מבצעים רדוקציה שלהם, וזה תהליך שעלול - במקום להעלות את החוכמה האנושית - להקטין אותה ואת היכולת שלנו להרחיב את תחומי הידע.

"שיפור הידע האנושי הוא הרבה פעמים תוצר של אנשים שניסו למתוח את הגבולות ולהגיד דברים שבהתחלה אחרים התנגדו להם. אני חושב שבעולם שמנוהל על-ידי מערכת בינארית שפחות מאפשרת לדיון כזה לקרות, דברים יהיו יותר מדי חדים וחותכים, במקומות שדווקא מורכבות ומופשטות עזרו לנו לאורך הדורות".

רציתם להראות את האבסורד בכך שחברות פרטיות הן אלה שמחליטות בנושאים הללו בשביל כלל החברה האנושית?

"אלה אפילו לא חברות הענק הפרטיות, כי מי שמחליט הרבה פעמים זה לא המנכ"לים, לא צוקרברג בעצמו, אלא אנשים בתפקידים מינוריים שיש להם הרבה סמכות לקבוע לנו גבול עם השלכות מאוד אמיתיות. אם אני בעל עסק וכל חיי העסקיים נבנים על זה שיש לי גישה לפייסבוק, ומסנן תוכן כלשהו החליט שמשהו שפרסמתי לא תקין והעסק שלי יורד מהאינטרנט לחמישה ימים - הפסדתי מלא כסף".

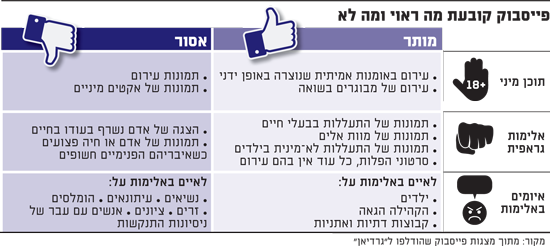

פייסבוק קובעת מה ראוי ומה לא

"בחברות הטכנולוגיה יש שני מעמדות"

בתחקיר שפורסם השבוע ב-The Verge, ניתן בנוסף למדיניות התוכן האבסורדית של פייסבוק גם דגש רב לתנאי העבודה המזעזעים של מסנני התוכן: עובד אחד חווה התקף לב ליד שולחנו במשרד ומת, והמנהלים ניסו למנוע מהעובדים לדבר על הנושא - מחשש לפגיעה בפרודוקטיביות; שתי עובדות דיווחו על הטרדות מיניות מצד קולגות מאז אפריל האחרון; ועובדת אחרת הקיאה בקביעות לתוך פח אשפה ליד שולחנה - בעקבות התכנים שראתה, והעובדה שניצלה כבר את הפסקות השירותים שהוקצו לה. אי-מתן טיפול נפשי מתאים לעובדים הוביל לריבוי מקרי אלימות מילולית ופיזית במשרד, ולכך שרבים מהם מתמודדים עם פוסט טראומה גם אחרי שהפסיקו לעבוד כמסנני תוכן. העדויות כללו גם תיאורים של סביבת עבודה מטונפת, עם שיער ערווה וציפורניים סביב השולחנות, מתקפת פשפשים שנמשכה שלושה חודשים ללא טיפול ושירותים שקירותיהם מרוחים בהפרשות גוף.

בפייסבוק פרסמו בתגובה לתחקיר: "אנחנו עובדים עם שותפי סינון התוכן שלנו כדי לספק את רמת התמיכה והתגמול הגבוהה ביותר בתעשייה. באופן בלתי נמנע, ישנם אתגרים ואי-סיפוק מצד העובדים, שמטילים בספק את המחויבות שלנו לעובדים של השותפים שלנו ולעבודה הזאת. כאשר הנסיבות דורשות נקיטת פעולה מצד ההנהלה, אנחנו מוודאים שזה קורה".

בשנה שעברה, מנכ"ל פייסבוק מארק צוקרברג הדגיש את הצורך במסנני תוכן אנושיים - ואת זמניותו - באמירה שזכתה לכותרות רבות. בשיחת משקיעים הוא הסביר למה בינה מלאכותית מצליחה היום למנוע באופן אוטומטי פרסום של תמונות עירום, אך מתקשה בתחומים אחרים: "יותר קל לייצר מערכת בינה מלאכותית שתזהה פטמה בתמונה מאשר להגדיר מה זה hate speech (דברי שטנה והסתה) מבחינה בלשנית, אבל אני חושב שעם הזמן אנחנו נשתפר. אלה לא בעיות שלא ניתן לפתור".

נראה שהתנאים הקשים והאופי הזמני של עבודות מסוג זה הולכים יד ביד: "נכון להיום, בחברות הטכנולוגיה יש שני מעמדות, והמעמד החדש הוא של עובדים שמחליפים בינה מלאכותית שעדיין לא קיימת", אומר זלמנסון. "הרבה אנשים חשבו שבינה מלאכותית תייתר את המשרות האלה, ושאת המחיר ישלמו האלגוריתמים. אבל האלגוריתמים של ימינו עדיין לא מספיק טובים, ומי שמשלם את המחיר הן האוכלוסיות הנזקקות ביותר, שאין להן את הפריבילגיה להחליט אם בא להן משרה מלאה עם זכויות או משרה זמנית. בשבילן, גם עבודה בלי זכויות היא עדיין מושכת".

לדברי זלמנסון, התוצאה היא ש"בשנים האחרונות אנחנו רואים המון חברות הייטק שצומחות בצורה כבירה, כי הן מראות שאפשר ליצור חברה בשווי של מיליארדי דולרים עם מספר עובדים מצומצם. אך האם אין עובדים סמויים - שעובדים לפעמים בתת תנאים - כדי שהעובדים הרשמיים של החברה יצליחו ובגדול? בהמון מקרים, החברות משתפות פעולה עם חברות קבלן. כך, נוצרת לצד החברה המקורית עוד חברת משנה - שלפעמים גדולה ממנה בהרבה. רבות מהעבודות האלה הן ללא תנאים סוציאליים והבטחת הכנסה לעתיד הבינוני-רחוק", הוא אומר.

ההצגה שיצרו זלמנסון ומגנט מבוססת בעיקרה על מצגות שהודלפו ב-2017, אז העסיקה פייסבוק כ-4,500 מסנני תוכן. מאז, בעקבות לחצים ציבוריים, החברה הרחיבה את צוות הבטיחות והאבטחה שלה, אותו מנהל גיא רוזן, סגן נשיא בחברה והישראלי הבכיר בפייסבוק כיום. לפי פייסבוק, כולל כיום הצוות של רוזן 30 אלף עובדים, כמחציתם מסנני תוכן שפועלים מסביב לעולם דרך חברות קבלן, גם במדינות מתפתחות.

הצורך של פייסבוק בהרחבת מערך מסנני התוכן נובע גם מלחצים שהופעלו עליה על-ידי פוליטיקאים, הציבור והתקשורת - בעקבות ניצול לרעה של הפלטפורמה להפצת תכנים בעייתיים. רק לאחרונה, פייסבוק ופלטפורמות נוספות היו נתונות לביקורת רבה לאחר שנכשלו לעצור במהירות את הסרטון בו נראה המפגע מהטבח בניו זילנד יורה בקורבנותיו.

הפלטפורמות מתמודדות מצד אחד עם דרישות לסנן תוכן ביעילות רבה יותר, ומצד שני, כשהן מעסיקות מסנני תוכן למטרה זו - הן שוב סופגות ביקורת.

"אני חושב שזה נהדר שהתקשורת, המדיה והאקדמיה מעלות את הדיון על זכויות עובדים ואדם. חברה מתוקנת מעלה שאלות וביקורת על תהליכי שינוי. אני לא אנטי-טכנולוגי, אני משתמש בכל הפלטפורמות, וחושב שחברות הטכנולוגיה עושות הרבה שינויים חיוביים בעולם, ושהן נמצאות במצב מאתגר - חשופות להמון ביקורת ומנסות להתמודד.

"שקיפות לגבי התופעה הזו זה הכיוון הנכון. אם למדנו על אנשים במכרות באפריקה שנהרגים בשביל רכיבים לתעשיית הסלולר, גם במקרה הזה צריך להביא את הדברים לאור יום ולעורר דיון ציבורי. אם המסקנה הציבורית תהיה שצריך להתמודד עם המחיר של התופעה כי היתרונות עולים על החסרונות, אבל לצד זה לעודד שקיפות ולשפר תנאים, זו תהיה מסקנה לגיטימית בעיני. אבל אי אפשר להגיע אליה בלי שמודעים בכלל למה שקורה מאחורי הקלעים".

ההצגה על מסנני התוכן היא נדבך נוסף בעיסוקו של זלמנסון בהתנהגות של אנשים שעובדים בסביבות דיגיטליות, ובהשפעה של אותן סביבות על ההתנהגות האנושית - בין היתר בעבודות זמניות מסוג זה. במחקר שערך על חברת אובר ב-2017, תיאר זלמנסון את מאות אלפי נהגי החברה ככאלה שעובדים תחת "ניהול אלגוריתמי" - ניהול של מכונה שמתייחסת אליהם כאל מכונות. המחקר תיאר לראשונה כמה מהדרכים בהן הנהגים התמודדו עם הניהול הזה. אחת מהן היא כיבוי סימולטני של האפליקציה, פעולה שיוצרת מחסור מדומה בנהגים באזור מסוים, וכך מעלה את מחירי הנסיעה והתגמול לנהגים. מאז שהמחקר חשף את השיטה הזו, פרסומים שונים בכלי התקשורת הראו כי נהגי אובר ממשיכים לנקוט בה ככלי התנגדות לאופן הניהול האלגוריתמי.

"אובר רק רוצה לתת את העבודה שלנו למכונות ולהוריד את התעריפים", כתב נהג מניו יורק בפורום עצמאי של נהגי החברה, בתגובה שהובאה במחקר. התבטאויות דומות ניתן למצוא גם אצל עובדי המחסן של אמזון: "עד שרובוטים יוכלו לעשות את העבודות האלה, הם רוצים להפוך אנשים למכונות", אמר מקס קרופורד, עובד לשעבר במחסן של אמזון בבריטניה, ל"ניו יורק טיימס" בשנה שעברה. עובדי המחסן של אמזון עובדים תחת רובוטים שאף "מנהלים" אותם ומכווינים אותם בעבודתם, ולפי תחקירים שפורסמו בשנים האחרונות - הם מצופים להגיע לרמת יעילות שגורמת להתמוטטויות בעבודה ואף לנטיות אובדניות. "אחרי שנה הרגשתי שהפכתי לגרסה של אחד הרובוטים שעבדתי איתם", אמר קרופורד ל"טיימס".

נראה שקרופורד, יחד עם יתר עובדי אמזון ואובר ומסנני התוכן של הפלטפורמות הדיגיטליות, הם כולם חלק מתופעה רחבה שמאפיינת משרות בחברות הטכנולוגיה הגדולות - אותן ממלאים אנשים רק עד שתתפתח טכנולוגיה שתוכל להחליף אותם - ובינתיים זוכים ליחס של רובוטים.

עבודות בהן בני אדם נאלצים למלא תפקיד של מכונה כשלב ביניים אינן תופעה חדשה. במאה ה-19, בלימה של רכבות התבצעה באופן ידני - בכל קרון בנפרד - באמצעות עובדים שנאלצו לטפס על גגות הקרונות בזמן נסיעה ולעבור ביניהם. איש בלימה היה אחראי לרוב על שניים או שלושה קרונות, ובמקרים מסוימים אף על חמישה או שישה - כאשר חברות הרכבת ניסו לצמצם בהוצאות. מוות של אנשי בלימה לא היה אז מאורע נדיר.

"אורפיאוס הולמס נהרג באופן מיידי מכך שראשו פגע בגשר בזמן שעמד על גג קרון", נכתב בדוח השנתי של אגודת עובדי הרכבות בצפון ארצות הברית ב-1852. למרות המחיר האנושי הגבוה, תאגידי הרכבות התנגדו נחרצות לחקיקה שתחייב אותם להחליף את עובדי הבלימה בבלמים אוטומטיים, בטענה שהטכנולוגיה לא מספיק מפותחת ואינה מדויקת כמו בני אדם.

אתה מאמין שהעובדה שהעבודות האלה שייכות לתקופת ביניים, עד שהטכנולוגיה תתפתח, מחייבת שיהיו כל כך קשות וללא תנאים?

"הסיבה ש'אי אפשר' להעסיק את העובדים האלה ולתת להם זכויות סוציאליות היא המודל העסקי של חברות ההייטק - שצומחות בזכות חסכוניות. יכולה להיות מציאות אחרת, אבל האם זה טוב לבעלי המניות? כנראה שלא. לכן, כדי לשנות את המצב ככל הנראה חייבים התערבות רגולטורית. אם אנחנו רוצים למקסם רווחה וזכויות עובדים, כנראה שכדאי להתערב. אם אנחנו רוצים למקסם את החדשנות והיצירתיות, כנראה שלא. זו משוואה מאוד מורכבת שצריך לקחת בחשבון".